阿里云计算巢模型市场提供开箱即用的大语言模型PD分离(Prefill-Decode分离)部署方案,基于ACS集群与专家并行优化,3分钟极速上线Qwen、Deepseek等MoE模型,吞吐提升1.5–2倍,零运维、高可用、企业级监控一应俱全。

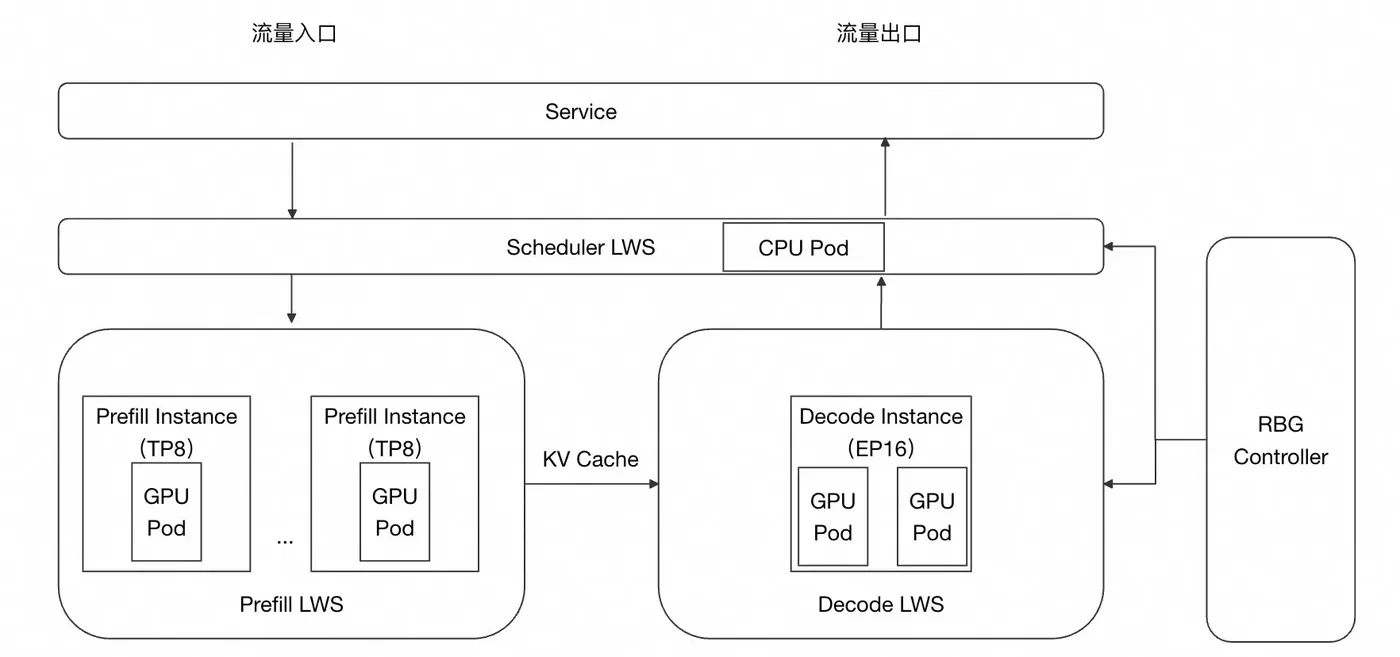

计算巢模型市场为大语言模型(LLM)提供了开箱即用的 PD 分离部署方案,无需手动配置复杂的基础设施即可实现生产级别的高性能推理服务。本方案基于阿里云容器计算服务 ACS集群,采用 PD 分离(Prefill-Decode 分离)架构和专家并行(Expert Parallelism)优化,为 MoE(Mixture of Experts)架构的大模型提供极致性能体验。

:通过计算巢控制台可视化界面,3 分钟即可完成 LLM 模型 PD 分离部署。全程无需手动配置 ACS 集群、OSS 存储、Kubernetes 组件、网络拓扑等复杂基础设施,真正实现零门槛上手,让您专注于业务创新而非底层运维。

:基于阿里云内部大规模生产实践和性能基准测试(SOTA)结果,预置最优性能参数配置。无需深入理解 PD 分离原理、专家并行机制、显存管理策略等复杂技术细节,即可获得业界领先的推理吞吐量和延迟表现。在生产环境中,同等算力下吞吐量可达到单机部署的1.5到2倍。详情可参考性能测试。

:开箱即用的企业级特性,包括多维度监控大盘(模型级、Pod 级、GPU 级)、支持弹性伸缩等,保障生产环境稳定。

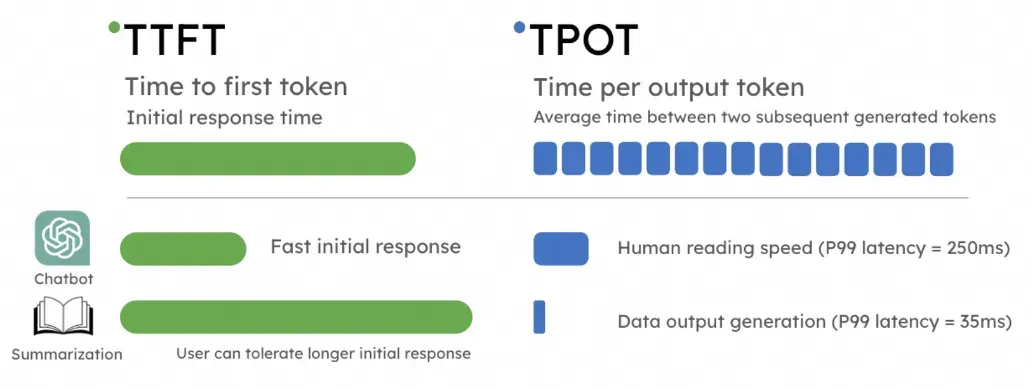

●Prefill (提示词处理) 阶段:此阶段一次性处理用户输入的全部提示词(Prompt),并行计算所有输入Token的注意力,并生成初始的KV缓存。这个过程是计算密集型(Compute-Bound)的,需要强大的并行计算能力,但只在请求开始时执行一次。

●Decode (解码生成) 阶段:此阶段是自回归过程,模型根据已有的KV缓存,逐个生成新的Token。每一步的计算量很小,但需要反复、快速地从显存中加载巨大的模型权重和KV缓存,因此是内存带宽密集型(Memory-Bound)的。

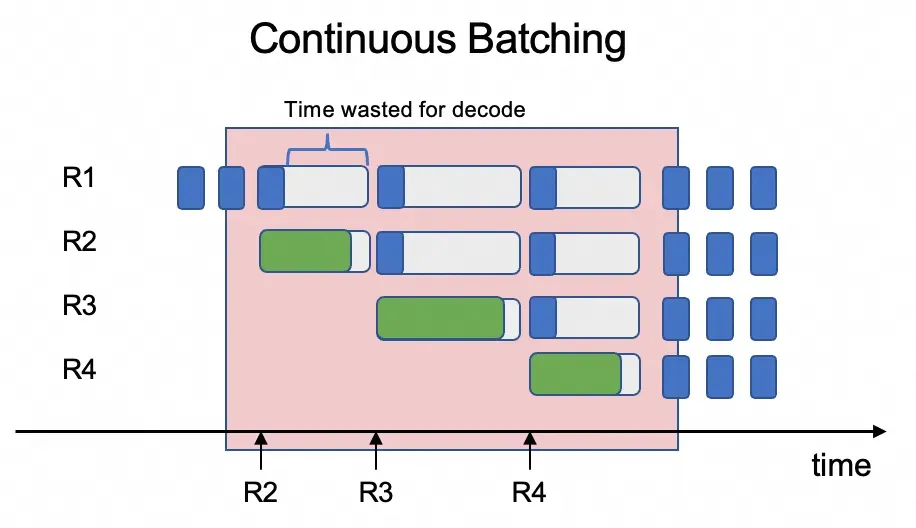

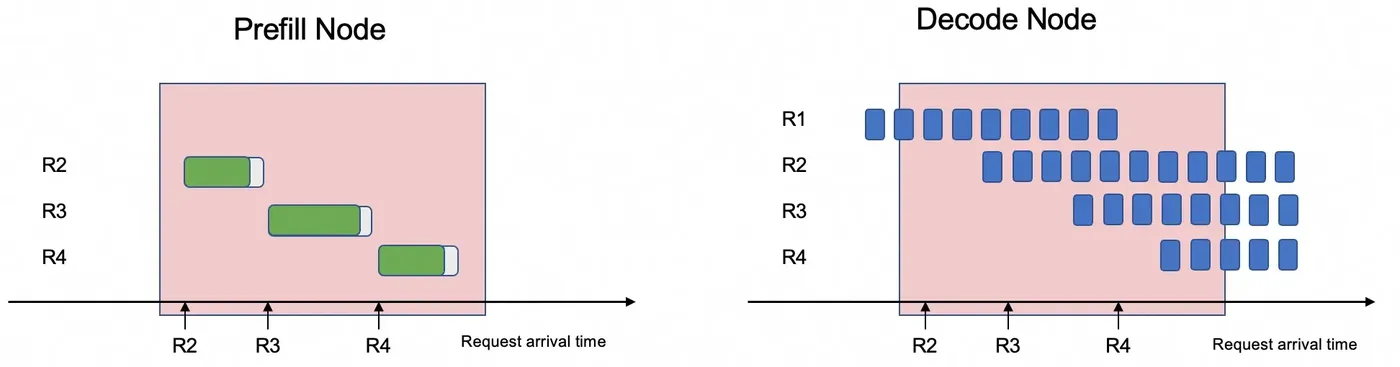

为了提升GPU利用率,推理引擎在处理多个用户请求时往往会采用凑批处理(Continuous Batching)的方式,将不同请求的Prefill阶段和Decode阶段放在一个批次里调度。Prefill阶段需要处理全部提示词因此计算时间长,Decode只需要计算一个Token因此计算时间短。若在同一批次中调度,Decode阶段会因等待Prefill导致时延增加,进而增加系统整体延迟并降低吞吐量。

PD分离架构的解决方案就是将这两个阶段解耦,将Prefill和Decode阶段分开部署在不同GPU上。通过分离部署,可以针对不同阶段的计算特性独立配置硬件资源、并行策略和优化参数,实现资源利用率和性能的双重提升。

如果您在部署模型服务或使用服务过程中遇到任何问题,可加入下面的钉钉群寻求技术支持。

OpenClaw、MaxClaw、KimiClaw 全面对比:2026 年 AI Agent 入门到底怎么选?

2026年AI Agent深度融入办公场景。OpenClaw(本地部署、高定制、强隐私)、MaxClaw(企业集成、开箱即用)、KimiClaw(极简上手、轻量高效)三条路径各具优势,覆盖技术团队、中大型企业与个人用户不同需求。

30分钟私有部署Deepseek-R1和V3,轻松拥有企业专属超大模型

阿里云计算巢推出了基于 ECS镜像、Vllm和Ray集群的超大模型一键部署方案。该方案通过预置标准化环境的ECS镜像,结合自动化云资源编排模板(如Ros模板),将Deepseek-R1和Deepseek-V3的私有化部署流程简化为一键操作。用户无需深入理解底层技术细节,即可在 30分钟内 快速完成模型环境搭建与服务启动,真正实现“开箱即用”的企业级超大模型服务。

你还在手动传包、靠“共享盘”发版本?Artifact Registry 才是依赖管理的终局答案!

你还在手动传包、靠“共享盘”发版本?Artifact Registry 才是依赖管理的终局答案!

OpenClaw从零到精通保姆级图文教程:新人阿里云/本地秒级搭建+微信/QQ/钉钉/飞书接入与免费大模型API配置攻略

2026年,OpenClaw(曾用名Clawdbot,因Logo酷似小龙虾被网友亲切称为“小龙虾”)作为开源AI智能体领域的现象级框架,凭借“Local-First”的核心特性,彻底打破传统AI“只说不做”的局限,实现了“指令输入→AI规划→工具调用→任务落地”的完整闭环,成为个人与轻量团队提升效率的核心装备。其最具价值的功能的之一,便是能无缝接入微信、QQ、钉钉、飞书四大主流通讯工具,无需切换APP,仅通过日常聊天指令,就能让AI助手完成文件处理、日程管理、信息检索、代码生成、跨平台协同等各类任务,线小时待命、高效落地工作。

面向Java企业的AI赋能平台,以“智能中台+场景化方案”为核心,提供模型网关、RAG知识库、Agent开发、多模态支持等能力,实现低侵入、低成本、高稳定的老系统AI化改造与原生应用开发,加速智能化升级。(239字)

OpenClaw公众号自动发文全流程:阿里云/本地部署OpenClaw+Skill无缝集成+百炼API配置详解教程

2026年,依靠人工撰写、排版、上传、发布公众号文章已经无法满足高频更新需求。借助AI智能体实现文章自动生成、Markdown排版、图片上传、草稿同步、定时发布,已经成为内容团队与个kaiyun体育全站 Kaiyun登录网页人博主的核心竞争力。OpenClaw(Clawdbot)作为本地优先、高度可扩展的AI执行框架,搭配专门用于公众号同步的wechat-publisher技能,可以实现从文章生成到草稿入库的全流程自动化,彻底解放双手,大幅提升内容产出效率。

阿里云轻量应用服务器38元1年和云服务器99元1年性能、适用场景区别及选择参考

阿里云特价服务器中,38元/年轻量应用服务器与99元/年云服务器ECS受入门用户关注。两者在定位、架构、场景及规则上差异显著:轻量应用服务器简化运维,提供高带宽,适合个人站长等;云服务器ECS则灵活可扩展,具备企业级稳定性,适合长期成本敏感型用户及技术开发者。

当AI批量写代码,程序员会失业吗?OpenAI实验显示:3名工程师+1500个AI智能体,5个月完成100万行代码——人类零编码!关键不在模型,而在“Harness Engineering”系统工程法:以规格书、质检台、工具架构建AI“自动驾驶”体系,重塑程序员为架构师、规则者与工具锻造师。

本文档全面介绍Feature Generator(FG)的各类特征算子配置方法,涵盖基础(ID/原始特征)、计算(表达式)、交叉(组合)、查找(Lookup/Match)、文本(重叠/BM25)、序列、预处理(分词/归一化)及字符串处理(正则替换/切片)等9大类算子,附详细配置示例与说明。

[UML]UML系列——用例图中的各种关系(include、extend)

企业级客户使用阿里云文件存储NAS SMB配置Home Directory服务指南

LeetCode:152_Maximum Product Subarray 最大乘积连续子数组 Medium

阿里云百炼Coding Plan售罄了怎么办?解决方法一次讲清,Lite停售,Pro怎么购买更省钱?

Java、Python、C,谁是你的菜?从Hello World看语言差异

告别 AI 对话 “失忆”!Spring AI 聊天记忆底层原理与全场景落地实战

阿里云轻量应用服务器2026指南:配置 + 价格 + 抢购攻略一次讲清

阿里云百炼Coding Plan订阅套餐详解:价格、模型支持、使用入口与注意事项(2026最新)

阿里云轻量服务器2026价格表曝光:38元起抢2核2G,4核16G直降千元

手慢无!阿里云轻量服务器2026最新秒杀价:2核4G配置199元/年,200M带宽不限流

最新官方报价 2026阿里云ECS、轻量、GPU服务器计费清单(含包年优惠)

从窗口句柄到智能代理:Win32 API MCP Tool 的落地记录与 DMXAPI